Künstliche Intelligenz ist für viele Unternehmen längst zum Alltag geworden. Ob Chatbots, die beim Kundensupport helfen oder Systeme, die Röntgenbilder von Patienten analysieren – die Einsatzfelder von KI sind vielfältig und finden sich in unterschiedlichen Bereichen wie Datensicherheit, Mobilität, Gesundheit oder Industrie 4.0 wieder. Unter den mannigfaltigen Diskussionen, die über den Einsatz Künstlicher Intelligenz geführt werden, spielt nicht zuletzt das Datenschutzrecht eine wichtige Rolle. Auch hier reguliert die Datenschutz-Grundverordnung (DSGVO) und gibt Instrumente vor, mit denen Künstliche Intelligenz datenschutzrechtlich sicher verwendet werden kann. Zu letzterem gehören unter anderem die Anonymisierung und Pseudonymisierung, mit welchen der vorliegende Beitrag sich eingehender befasst.

Künstliche Intelligenz und ihre rechtliche Regulierung

Zunächst sollte geklärt werden, welche Arten von Anwendungen unter den Begriff der KI fallen. Eine eindeutige Definition existiert nicht und ist aufgrund der Komplexität der Technologie auch nicht möglich. Allerdings kann sich einer solchen angenähert werden: KI-Anwendungen sollten etwa zu eigenständigen Lernprozessen und Prognosen in der Lage sein, Muster erkennen und auf unbekannte Probleme reagieren können. Anwendungen zur Sprach- und Zeichenerkennung oder Bild- und Datenanalyse gehören auch dazu.

Für die meisten KI-Anwendungen ist die Verarbeitung personenbezogener Daten maßgeblich, die analysiert und/oder als Trainingsdaten verwendet werden, um die KI zu verbessern. Hier setzt das Datenschutzrecht an. Da Künstliche Intelligenz in der Lage ist, eigenständig sehr umfangreiche Aufgaben zu übernehmen, ist von der Datenschutzkonferenz (DSK) die Hambacher Erklärung veröffentlicht worden, die Leitlinien für den Einsatz von KI enthält. Grundlegend soll der sich aus der Menschenwürde ergebende Grundsatz sein, dass der Mensch durch KI nicht zum Objekt degradiert werden darf. Sie sollte nur für vorab klar festgelegte, verfassungsrechtlich legitime Zwecke eingesetzt werden sowie transparent funktionieren. Der datenschutzrechtliche Grundsatz der Datenminimierung sollte berücksichtigt, technisch-organisatorische Mindeststandards sollten erfüllt und eine verantwortliche Stelle angegeben sowie Diskriminierungen vermieden werden.

Der Grundsatz der Datenminimierung

Bevor erläutert wird, wie Anonymisierung und Pseudonymisierung bei der Umsetzung von Datenschutz helfen können, muss auf den Datenminimierungsgrundsatz eingegangen werden, der sich nicht nur aus der (nicht bindenden) Hambacher Erklärung ergibt, sondern ausdrücklich in Art. 5 Abs. 1 lit. c DSGVO genannt ist. Er verpflichtet zu einer dem Zweck angemessenen und auf das notwendige Maß beschränkten Datenverarbeitung. Diese Verpflichtung beinhaltet auch die technische Gestaltung der zugrundeliegenden Systeme auf eine Weise, die Risiken für die betroffenen Personen minimiert (Privacy by Design) und die durch datenschutzfreundliche Voreinstellungen sicherstellt, dass nur für den jeweiligen Zweck erforderliche personenbezogene Daten verarbeitet werden (Privacy by Default). Mit den Instrumenten Anonymisierung und Pseudonymisierung kann unterschiedlich auf die Verpflichtung zur Datenminimierung reagiert werden. Während Unternehmen mit der Pseudonymisierung der von einer KI verwendeten Daten das Datenschutzrisiko senken können, lässt sich mit der Anonymisierung erreichen, dass die DSGVO und damit auch der Grundsatz der Datenminimierung gar nicht erst anzuwenden sind.

Die Anonymisierung

Unter der Anonymisierung von Daten ist ein Verfahren zu verstehen, bei dem personenbezogene Daten so verändert werden, dass die Person, auf die die Daten sich beziehen, nicht mehr identifizierbar ist. Die Person kann nicht mehr ermittelt werden und ist keinen Risiken ausgesetzt, wenn anonymisierte Daten verarbeitet werden. Daher muss sie auch nicht mehr datenschutzrechtlich geschützt werden. So kann der Compliance-Aufwand erheblich verringert werden. Das gilt aber nur, wenn die Re-Identifikation sicher ausgeschlossen ist. Häufig ist das mit einem gewissen Aufwand und der Zuhilfenahme anderer Informationen doch möglich. Das gilt ganz besonders dann, wenn viele oder umfangreiche Daten von KI analysiert werden. Aus der Kombination von Informationen wie Alter, Adresse, Gewicht, Vorerkrankungen etc. kann schnell wieder die dahinterstehende Person erkennbar gemacht werden. Für Unternehmen gilt daher: Da sich mit der Anonymisierung von Daten eine Anwendung der datenschutzrechtlichen Vorschriften ausschließen lässt, sollte diese Möglichkeit im Vorfeld geprüft werden. Wenn auch mit anonymen Daten gearbeitet werden kann, sollte noch einmal besonders darauf geachtet werden, dass die Daten auch wirklich vollständig anonym sind, eine Ermittlung der Personen also sicher ausgeschlossen ist.

Die Pseudonymisierung

Vielfach wird diese Prüfung ergeben, dass eine vollständige Anonymisierung nicht möglich ist, zum Beispiel weil die eingesetzte Künstliche Intelligenz personenbezogene Daten benötigt, um sinnvolle Ergebnisse liefern oder sich weiter verbessern zu können. Auch kann es sein, dass der Personenbezug wichtig ist, um Informationen über einen längeren Zeitraum zu einem Kunden oder einem Patienten zuordnen zu können. Sobald die KI also personenbezogene Daten – hier kann es sich etwa um Informationen wie Name, Anschrift, E-Mail-Adresse, um biometrische, Prognose- oder Metadaten handeln – verarbeitet, sind die Bestimmungen der DSGVO umzusetzen, d. h. auch der Grundsatz der Datenminimierung. Hier kommt die Pseudonymisierung als Instrument ins Spiel, um das Datenschutzrisiko für die betroffenen Personen zu senken und dem Grundsatz der Datenminimierung Rechnung zu tragen. Unter Pseudonymisierung versteht Art. 4 Nr. 5 DSGVO Folgendes:

„Die Verarbeitung personenbezogener Daten in einer Weise, dass die personenbezogenen Daten ohne Hinzuziehung zusätzlicher Informationen nicht mehr einer spezifischen betroffenen Person zugeordnet werden können, sofern diese zusätzlichen Informationen gesondert aufbewahrt werden und technischen und organisatorischen Maßnahmen unterliegen, die gewährleisten, dass die personenbezogenen Daten nicht einer identifizierten oder identifizierbaren natürlichen Person zugewiesen werden“.

Auch hier erfolgt also eine Trennung von Daten und Person, allerdings nur soweit zusätzliche verfügbare Informationen nicht zur Ermittlung der Person herangezogen werden. Daher sollten diese zusätzlichen Informationen gesondert aufbewahrt und entsprechend vor unbefugtem Zugriff geschützt werden. Im Rahmen des technischen Datenschutzes nennt die DSGVO selbst in Art. 32 beispielhaft Pseudonymisierung als geeignete technische und organisatorische Maßnahme, um den Grundsatz der Datenminimierung einzuhalten. Das Risiko von Datenschutzvorfällen sinkt durch Pseudonymisierung deutlich. Es soll schon technisch ausgeschlossen werden, was nicht erlaubt ist. Datenschutzfreundliche technische Maßnahmen und Voreinstellungen zum frühestmöglichen Zeitpunkt werden außerdem positiv bei der Verhängung von Bußgeldern berücksichtigt. Unternehmen sollten daher vor dem Einsatz von KI auch die Möglichkeit der Pseudonymisierung prüfen.

Wie werden Anonymisierung und Pseudonymisierung umgesetzt?

Um sowohl Anonymisierung als auch Pseudonymisierung rechtssicher und effektiv einsetzen zu können, empfiehlt es sich, beide Instrumente schon frühzeitig bei der Entwicklung der KI-Anwendung zu bedenken. Etwa sollten bereits die Rohdaten verändert oder unkenntlich gemacht werden, sodass von Anfang an nur pseudonymisierte bzw. anonymisierte Daten in den Lernprozess der KI gegeben werden.

Bei der Anonymisierung gilt es, die Möglichkeit der Re-Identifikation der Person genau zu prüfen. Hier sind auch die Kosten und der Zeitaufwand einer etwaigen Identifizierung zu berücksichtigen. Wichtig ist zudem, dass diese Prüfung nicht nur einmal am Anfang vorgenommen, sondern immer wieder erneuert wird, da sie immer nach dem aktuellen Stand der Technik erfolgen muss. Konkrete Vorgaben für die Technik der Anonymisierung gibt die DSGVO nicht vor, es kommt hier vor allem auf das Resultat an. Dennoch gibt es einige Möglichkeiten, eine Anonymisierung vorzunehmen. Beispielsweise können die identifizierenden Merkmale gelöscht werden. Denkbar ist auch eine Generalisierung der Daten, indem etwa die genaue Anschrift durch die Region oder das Geburtsdatum durch das Geburtsjahr ersetzt werden.

Wie bereits gezeigt, handelt es sich um Pseudonymisierung, wenn die Daten nicht gelöscht, sondern gesondert aufbewahrt werden. Der (ausreichende) Schutz dieser Informationen ist in der Praxis häufig problematisch und sollte ebenfalls genau auf seine Wirksamkeit geprüft werden. Um Daten zu anonymisieren, kann einer Person z. B. die Möglichkeit gegeben werden, eine Nutzer-ID zu wählen. Auch kann ein Dritter der Person ein Pseudonym zuweisen. Eine Verschlüsselung der Daten kann auch zu einer Pseudonymisierung führen, wenn die Daten nur durch die Zuhilfenahme des Schlüssels wieder lesbar sind.

Fazit

Der Vorteil von Anonymisierung liegt auf der Hand: Die Nichtanwendung der DSGVO mindert den Aufwand für den KI-Verwender erheblich. Doch auch die Anonymisierung birgt, neben dem grundsätzlich erhöhten Datenschutzniveau, einige Vorteile. Wenn eine Abwägung zwischen den Interessen des Verantwortlichen und denen der betroffenen Personen vorgenommen werden muss, fällt diese eher zugunsten des Verantwortlichen vor. Zudem kann bei Datenschutzvorfällen die Benachrichtigungspflicht entfallen. Schließlich verringern sich auch die Anforderungen an die Umsetzung technisch-organisatorischer Maßnahmen. Daher sollten Verantwortliche beim Einsatz von KI erwägen, ob Pseudonymisierung oder Anonymisierung möglich sind, ohne die Künstliche Intelligenz zu sehr in ihrem Einsatzfeld einzuschränken.

-

Die wichtigsten Fragen zu Datenübermittlung an US-Dienste: Was bedeutet der neue EU-US Datenschutzrahmen für Unternehmen?

Die Europäische Kommission hat einen neuen Angemessenheitsbeschluss nach Artikel 45 Abs. 3 der DSGVO für die USA erlassen: Das „EU-US Data Privacy Framework“ (EU-US-Datenschutzrahmen). Damit stellt die Kommission nach dem vom EuGH im Juli 2020 gekippten Privacy Shield erneut fest, dass die USA ein angemessenes Schutzniveau für aus der EU übermittelte personenbezogene Daten gewährleisten können.

-

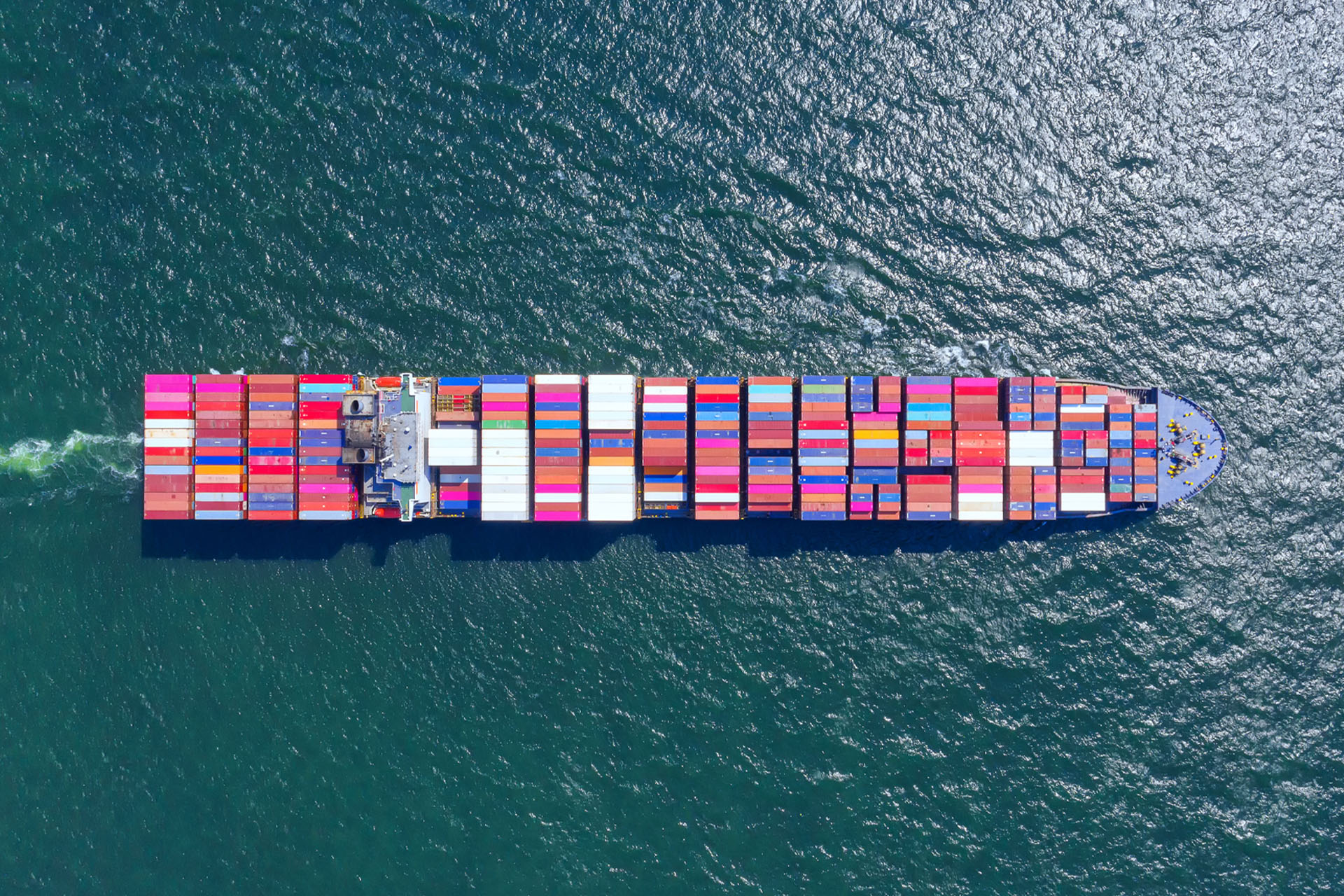

KI in der Logistik: Chancen, Herausforderungen und Datenschutzstrategien

Die Logistikbranche in Deutschland hat die Chancen und Möglichkeiten der Künstlichen Intelligenz (KI) erkannt und ist vielen anderen Wirtschaftszweigen bereits weit voraus. Dieser Blogbeitrag zeigt auf, welche konkreten Einsatzmöglichkeiten KI in der Logistik bietet und wie Datenschutzanforderungen bei der Implementierung von KI-Lösungen erfüllt werden können.

-

KI im Recruiting: Chancen und Datenschutz-Risiken für Unternehmen

Künstliche Intelligenz ist in aller Munde und wird längst auch in HR-Prozessen eingesetzt. Vor allem in der Personaladministration sind KI-Tools statistisch gesehen beliebt. Im folgenden Beitrag wollen wir die populärsten KI-Potenziale im Recruiting vorstellen und einen Überblick über deren Chancen, Risiken und Herausforderungen geben.